Ekspert: “Texnologiya sadəcə bir vasitədir, problem insandadır”

ABŞ-nin Las-Veqas şəhərində “Tesla Cybertruck”ın partladılması ilə bağlı cinayət işində maraqlı detallar ortaya çıxıb. Şəhər polisinin şerifi Kevin Mak Mahill bildirib ki, şübhəli şəxs süni intellekt olan ChatGPT-dən cinayəti planlaşdırmaq üçün istifadə edib.

“Bizdə sübutlar var ki, şübhəli şəxs hücumu planlaşdırmaq üçün ChatGPT-dən yararlanıb,” - deyə şerif qeyd edib.

Hüquq-mühafizə orqanlarının məlumatına görə, şübhəli Metyu Layvelsberqer süni intellekt vasitəsilə partlayıcı maddələrin miqdarını və fişəngləri haradan əldə edə biləcəyini öyrənməyə çalışıb.

“Yeni Musavat” xatırladır ki, hadisə Las-Veqasda, “Trump International Hotel”in qarşısında baş verib. “Tesla Cybertruck” pikapının partlaması nəticəsində bir nəfər həyatını itirib, yeddi nəfər xəsarət alıb. Polis bu hadisəni potensial terror hücumu kimi araşdırır.

“Biz bilirdik ki, süni intellekt bir şəkildə həyatımıza təsir edəcək. Lakin bu, ABŞ-də ChatGPT-dən belə məqsədlə istifadə edildiyi ilk məlum hadisədir,” - deyə şerif vurğulayıb.

Polis şübhəlinin ChatGPT-yə verdiyi sorğulara konkret olaraq hansı cavabları aldığını açıqlamayıb.

Doğrudan da bıçaq cərrahın əlində bir, quldurun əlində isə ayrı anlamdadır.

Bəs bəşəriyyət süni intellektin bu qəbil ağır fəsadlarından özünü qoruya biləcəkmi?

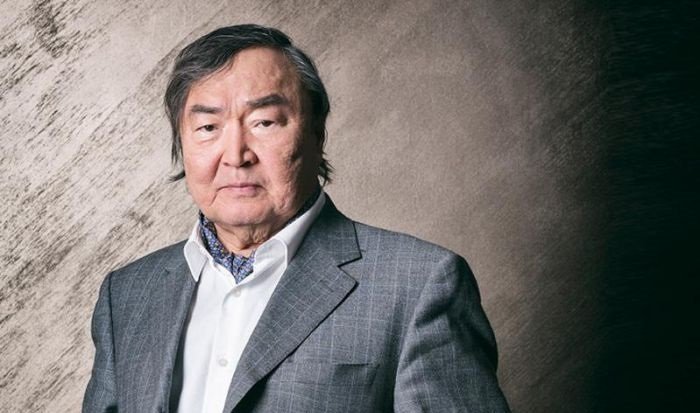

İnformasiya texnologiyaları sahəsində ekspert Mehman Xəlilov Yeni Müsavat qəzetinə açıqlamasında deyib ki, bu hadisədə, nə qədər acınacaqlı olsa da, bəşəri fəsad görmür.

“Hadisəyə soyuqqanlı yanaşaq. Bəli, faciə baş verib, onun əsas səbəbkarı süni intellekt deyil axı. Süni intellekt sadəcə bir alətdir, məsələn, çəkic və ya bıçaq kimi. Kiminsə onu ev tikmək və ya yemək hazırlamaq üçün istifadə etməsi mümkündür, amma başqa birisi bu aləti zərər vermək üçün işlədə bilər. Əgər ChatGPT olmasaydı, həmin şəxs həmin məlumatları başqa yerdən - kitablardan, forumlardan və ya digər mənbələrdən öyrənəcəkdi. Biz axı nə axtarış sistemlərini, nə də kitabxanaları informasiyaya çıxış təmin etdiklərinə görə günahlandırmırıq.

Mən mətbuatdan hadisə ilə bağlı son məlumatları oxumuşam. Həmin şəxsin məktubu haqqında da hüquq-mühafizə orqanları məlumat yayıb. “Cybertruck” sadəcə diqqət çəkmək üçün bundan istifadə edib. O, öz daxili böhranını ifadə etmək üçün ən gurultulu yolu seçib. Bu, müəyyən mənada bəzi insanların öz etirazlarını bildirmək üçün radikal üsullara əl atmasına bənzəyir. Onların məqsədi zərər vermək deyil, sadəcə, başqa çıxış yolu görmürlər.

Amma gəlin baxaq, görək bu hadisə bizə nəyi öyrədir. Kimsə düşünə bilər ki, problem texnologiyalardadır, amma elə deyil. Texnologiya sadəcə bir vasitədir. Problem insandadır. Onun məktubunun məzmunundan, atasının verdiyi müsahibədən də görünür ki, 37 yaşlı Metyu Layvelsberger böhran vəziyyətində olub. O, ChatGPT-nin bilik bazasında partlayıcı maddə hazırlayıb və istifadə edib. Amma eyni məlumatdan başqa birisi partlayıcı maddələr haqqında elmi iş yazmaq üçün də istifadə edə bilər. Kiminsə zərərli ideyaları kitabdan öyrənməsi halında kitabxanaları bağlayırıqmı? Əlbəttə ki, yox. Söhbət qadağadan yox, insanların belə ümidsiz vəziyyətlərə düşməsinin qarşısını necə almaqdan getməlidir.

Şübhəsiz ki, süni intellekt yaradan şirkətlər, məsələn, OpenAI, təhlükəsizlik istiqamətində mütəmadi olaraq işlər görürlər və görməlidirlər. Məsələn, ChatGPT zərərli fəaliyyətlər üçün təlimatlar vermir və yaxud məlumat verdikdə təhlükə barədə xəbərdarlıq edir. Amma bu nəzarət mexanizmlərini 100%-lik təkmilləşdirmək heç vaxt mümkün olmayacaq. İnsan istəyərsə, texnologiyalardan zərər vermək məqsədi ilə istifadə edə bilər. Bu, alətin günahı deyil, məsuliyyət məsələsidir. Kimsə kəsici alətdən silah kimi istifadə edirsə, onda cərrahlar neştərsiz qalmalıdır? Xeyr.

Hadisə bəşəriyyətin fəsadları haqqında deyil, daha dərindən baxsaq, cəmiyyətdəki problemlərdən xəbər verir. Bu, tənhalıq, dəstəyin olmaması və inamsızlıq böhranı haqqındadır. Süni intellekt burada sadəcə bir dekorasiyadır. Biz texnologiyaların qadağası, yaxud məhdudlaşdırılması haqqında yox, insanlara daha diqqətli və həssas olmaq yolları barədə düşünməliyik".

İnformasiya texnologiyaları üzrə ekspert Fərhad Mirəliyev deyir ki, süni intellekt yeni istifadəyə verildiyi vaxtlarda onun təhlükəsi aktual məsələlərdən biri idi. Sonradan təhlükənin qarşısını almaq üçün xüsusi alqoritmlər tətbiq edildi. Bununla da süni zəkanın etik kodeksi hazırlandı.

“Beləliklə, cinayət tərkibi olan, zərərli suallarla bağlı süni intellekt insanlara bildirdi ki, belə suallara cavablar olmayacaq. Lakin sonradan müəyyən üsullarla, yenə də dolaşdırıcı suallar verməklə insanlar öz istədiklərinə cavablar ala bildilər. Hazırda süni intellektin etik davranış qaydaları ilə bağlı iş davam edir.

Süni intellektdən zərərli məqsədlər üçün istifadə ölkələrdən deyil, istifadə edən insanın niyyətindən asılıdır. Cinayətkar ölkə tanımır, niyyətinə, hədəfinə bağlı olur".